Gemma 2 только что ворвалась на сцену 2D AI и вызвала настоящий переполох. Эта крошечная модель доказывает, что хорошие вещи приходят в маленьких упаковках, и вызывает настоящий разговор в мире технологий.

Последнее изобретение Google, Gemma 2 2B, представляет собой компактную языковую модель с всего 2,6 миллиардами параметров. Несмотря на свой небольшой размер, эта мощная система искусственного интеллекта не уступает своим более крупным собратьям. Она не только говорит, но и делает то же самое, соответствуя и даже превосходя модели, которые в десять раз больше ее.

Блестящее выступление Gemma 2 2B

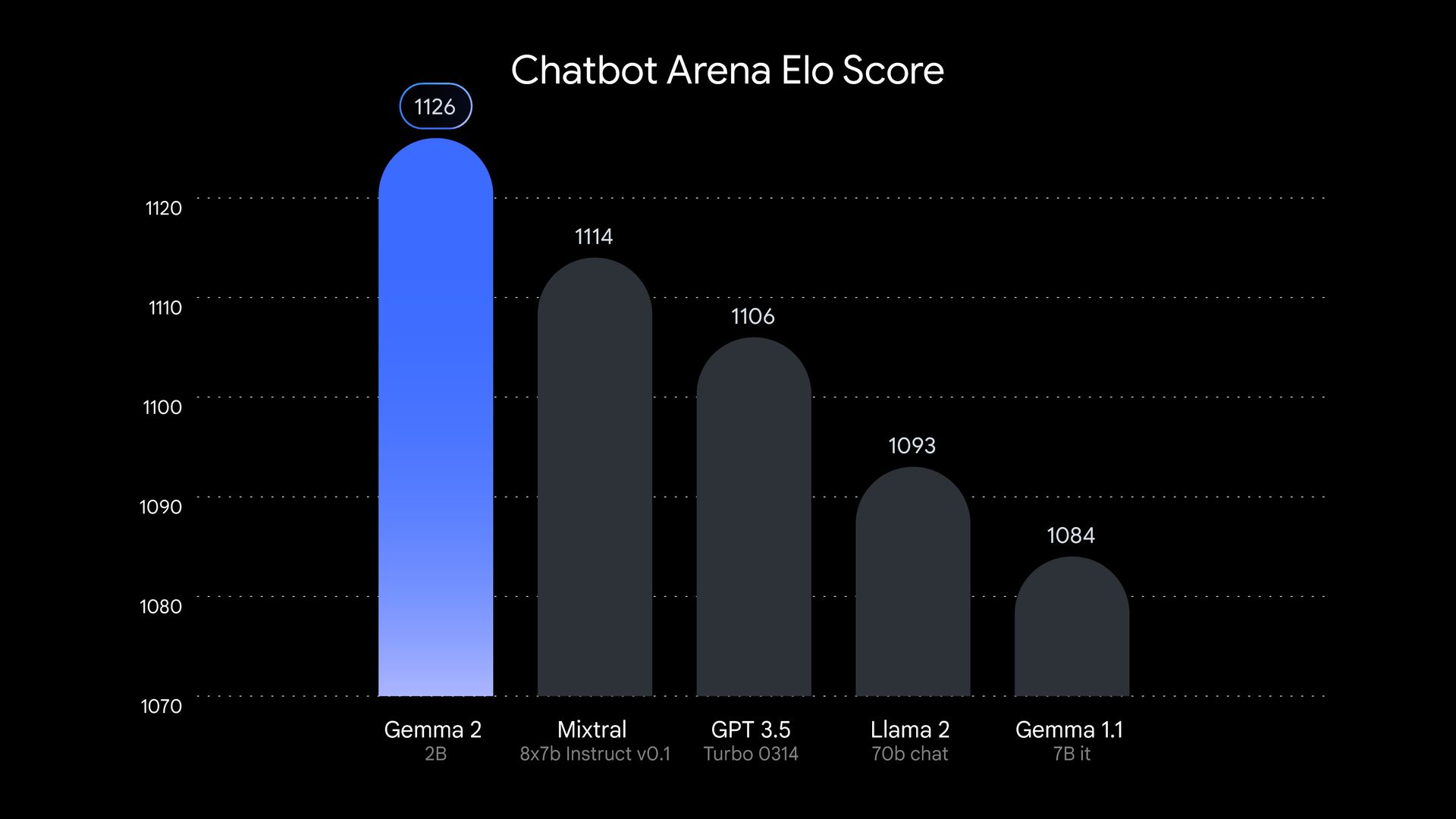

Давайте проясним, что Gemma 2 2B не является еще одной крупной силой в большой толпе ИИ. Эта модель была подвергнута испытанию и блестяще себя проявила. В тестах, проведенных LMSYSнезависимая исследовательская группа ИИ, Gemma 2 2B показала впечатляющие результаты 1130 баллов на арене оценки. Да, это маленькое сокровище превзошло некоторые громкие имена, такие как GPT-3.5-Turbo-0613 и Mixtral-8x7B.

Но Gemma 2 2B не останавливается на достигнутом. Он показывает, что он умен и в других областях. В ММЛУ Тест, который проверяет способность модели понимать и рассуждать о различных темах, Gemma 2 2B набрал 56,1 балла. Что касается кодирования, то он набрал 36,6 баллов в МБПП тест. Эти цифры представляют собой качественный скачок по сравнению с предшественником.

Так как же Google создай этот маленький интересно? Gemma 2 2B была обучена на огромном наборе данных из 2 триллионов токенов с использованием передового оборудования TPU v5e от Google. Этот процесс обучения позволил модели упаковать много информации в ее компактный корпус. Gemma 2 2B также является многоязычной, что расширяет ее потенциальные варианты использования по всему миру. Это делает ее универсальным инструментом для разработчиков и исследователей, работающих над международными проектами.

Успех Gemma 2 2B бросает вызов идее, что больше всегда лучше в ИИ. Его впечатляющие результаты показывают, что при правильных методах обучения, эффективной архитектуре и высококачественных данных меньшие модели могут значительно превзойти свою весовую категорию. Эта разработка может сместить фокус в исследованиях ИИ с создания более крупных моделей на улучшение меньших, более эффективных моделей. Это изменение может иметь далеко идущие последствия для этой области и потенциально сделать ИИ более доступным и экологически чистым.

Полировка будущего ИИ

Gemma 2 2D представляет собой растущую тенденцию в ИИ к более эффективным моделям. По мере того, как растет обеспокоенность по поводу воздействия на окружающую среду и доступности больших языковых моделей, технологические компании ищут способы создания меньших систем, которые могут работать на повседневном оборудовании.

Успех Gemma 2 2D также подчеркивает важность методов сжатия и дистилляции моделей. Эффективно сжимая знания из более крупных моделей в более мелкие, исследователи могут создавать более доступные инструменты ИИ, не жертвуя производительностью.

Такой подход не только снижает вычислительную мощность, необходимую для запуска этих моделей, но и решает проблемы воздействия на окружающую среду обучения и запуска крупных систем ИИ. Это беспроигрышная ситуация, которая может сформировать будущее развития ИИ.

Gemma 2 2B доказывает, что когда дело касается ИИ, важен не размер, а то, как вы его используете. Эта небольшая, но мощная модель бросает вызов нашим предположениям об ИИ и прокладывает путь новому поколению эффективных, мощных и доступных систем ИИ. Очевидно, что эта маленькая жемчужина будет сиять в мире ИИ.

Источник изображения: Google

Source: Размер не имеет значения: Gemma 2 2B доказывает, что ИИ может мыслить компактно