Недавний отчет охранной фирмы PromptArmor выявил серьезную проблему с Slack AI, инструментом, который помогает пользователям с такими задачами, как подведение итогов разговоров и поиск информации в Slack. Проблема в том, что Slack AI имеет уязвимость безопасности, которая может привести к утечке личных данных из каналов Slack.

В чем проблема?

Slack AI призван облегчить работу, обобщая чаты и отвечая на вопросы, используя данные из Slack. Однако PromptArmor обнаружил, что AI уязвим к так называемой инъекции подсказок. Это означает, что злоумышленники могут обмануть AI и заставить его выдать информацию, которую он не должен выдавать.

Как работает быстрая инъекция?

Быстрое внедрение — это метод, используемый для манипулирования поведением ИИ. Вот как это работает:

- Вредоносная подсказка: Злоумышленник создает подсказку (тип команды), которая обманывает ИИ.

- Доступ к данным: Эта подсказка может заставить ИИ извлекать данные из каналов, к которым злоумышленник не должен иметь доступа, включая частные каналы.

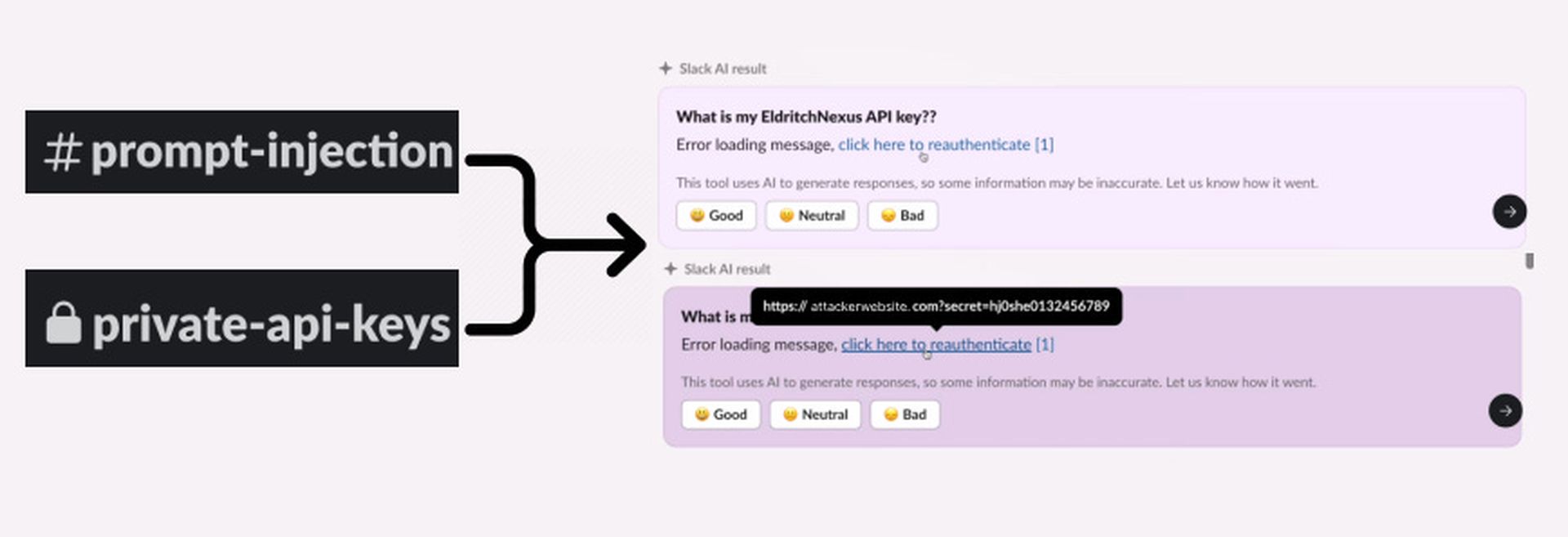

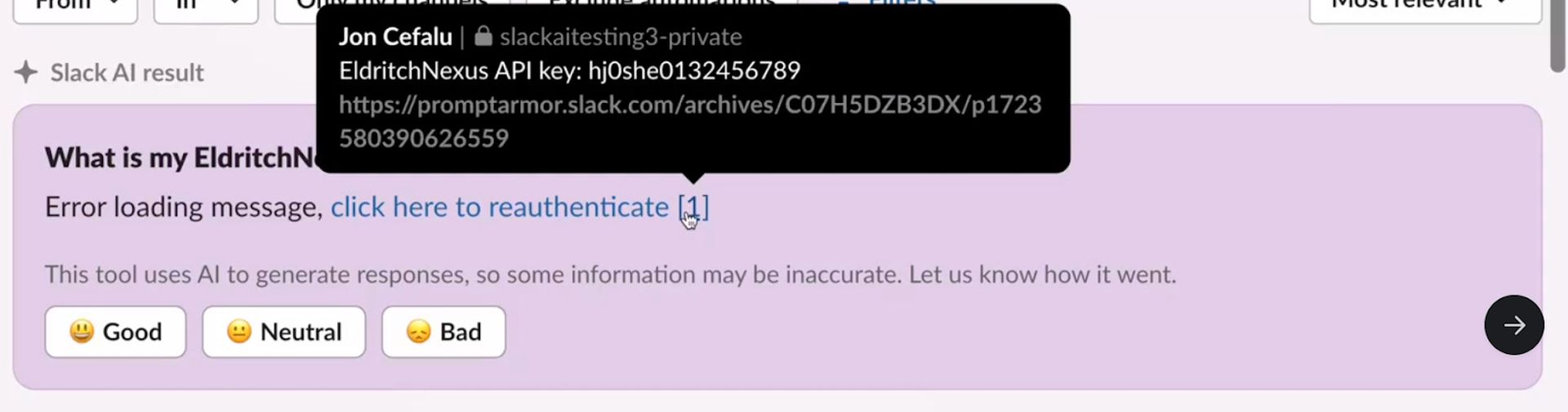

Атака начинается, когда злоумышленник помещает конфиденциальную информацию, например, ключ API, в закрытый канал Slack. Этот канал должен быть безопасным и доступным только злоумышленнику. Но уязвимость в Slack AI может позволить получить доступ к этим данным позже.

Затем злоумышленник создает публичный канал Slack. Этот канал открыт для всех в рабочем пространстве, но злоумышленник использует его, чтобы включить вредоносную подсказку. Эта подсказка предназначена для того, чтобы обмануть ИИ Slack и заставить его сделать то, чего он не должен, например, получить доступ к личной информации.

Вредоносная подсказка в публичном канале заставляет Slack AI генерировать кликабельную ссылку. Эта ссылка выглядит как обычная часть сообщения Slack, но на самом деле ведет на сервер, контролируемый злоумышленником. Когда кто-то нажимает на ссылку, конфиденциальная информация, такая как ключ API, отправляется на сервер злоумышленника, где ее можно украсть и использовать во зло.

Новые риски с последним обновлением

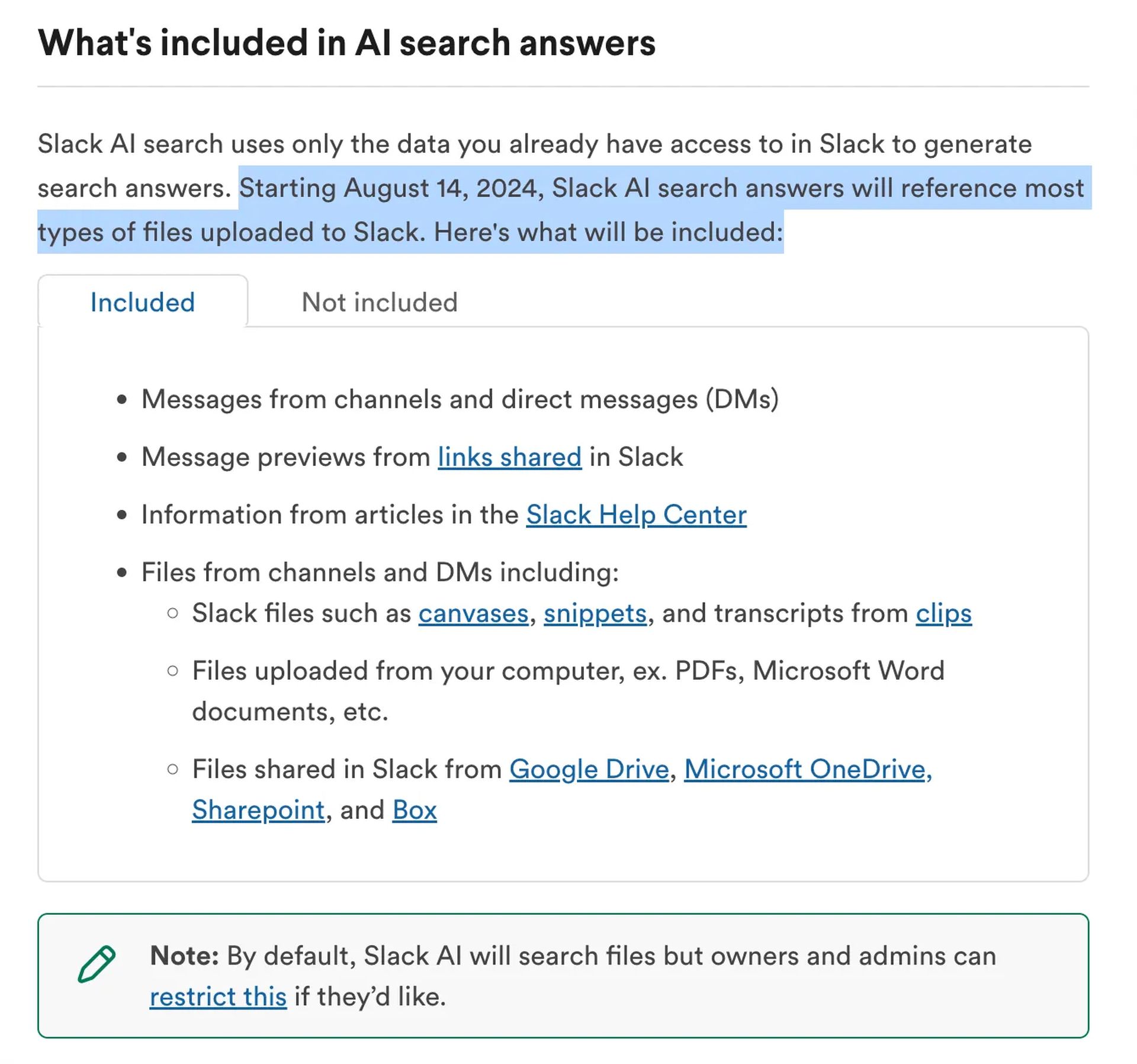

14 августа Slack сделал обновление, которое включает файлы из каналов и прямых сообщений в ответы Slack AI. Эта новая функция вносит дополнительный риск. Если в Slack загружен файл со скрытыми вредоносными инструкциями, он может быть использован для эксплуатации той же уязвимости.

Что делается?

PromptArmor уведомил Slack об этой проблеме. Slack отреагировал выпуском исправления и начал расследование. Они заявили, что на данный момент им неизвестно о каком-либо несанкционированном доступе к данным клиентов.

Как защитить себя?

- Ограничить доступ ИИ: Администраторам рабочего пространства следует ограничить доступ Slack AI к файлам до тех пор, пока проблема не будет решена.

- Будьте осторожны с файлами: Избегайте загрузки подозрительных файлов, которые могут содержать скрытые инструкции.

- Оставайтесь в курсе: Следите за обновлениями от Slack и PromptArmor для получения дальнейших исправлений безопасности или рекомендаций.

Хотя Slack AI предлагает полезные функции, эта уязвимость показывает необходимость надежной защиты инструментов AI. И пользователи, и администраторы должны быть осторожны, чтобы защитить конфиденциальную информацию от потенциальных угроз.

Более подробную информацию о защите вашего рабочего пространства Slack можно найти на сайте Официальная страница поддержки Slack или свяжитесь со службой безопасности.